版权说明:本文档由用户提供并上传,收益归属内容提供方,若内容存在侵权,请进行举报或认领

文档简介

1/1朴素贝叶斯模型的集成学习与融合算法第一部分朴素贝叶斯模型综述 2第二部分集成学习概念与分类 4第三部分朴素贝叶斯集成学习架构 7第四部分朴素贝叶斯集成学习方法 10第五部分朴素贝叶斯融合算法综述 12第六部分朴素贝叶斯融合算法类型 14第七部分朴素贝叶斯融合算法比较 17第八部分朴素贝叶斯集成与融合应用 19

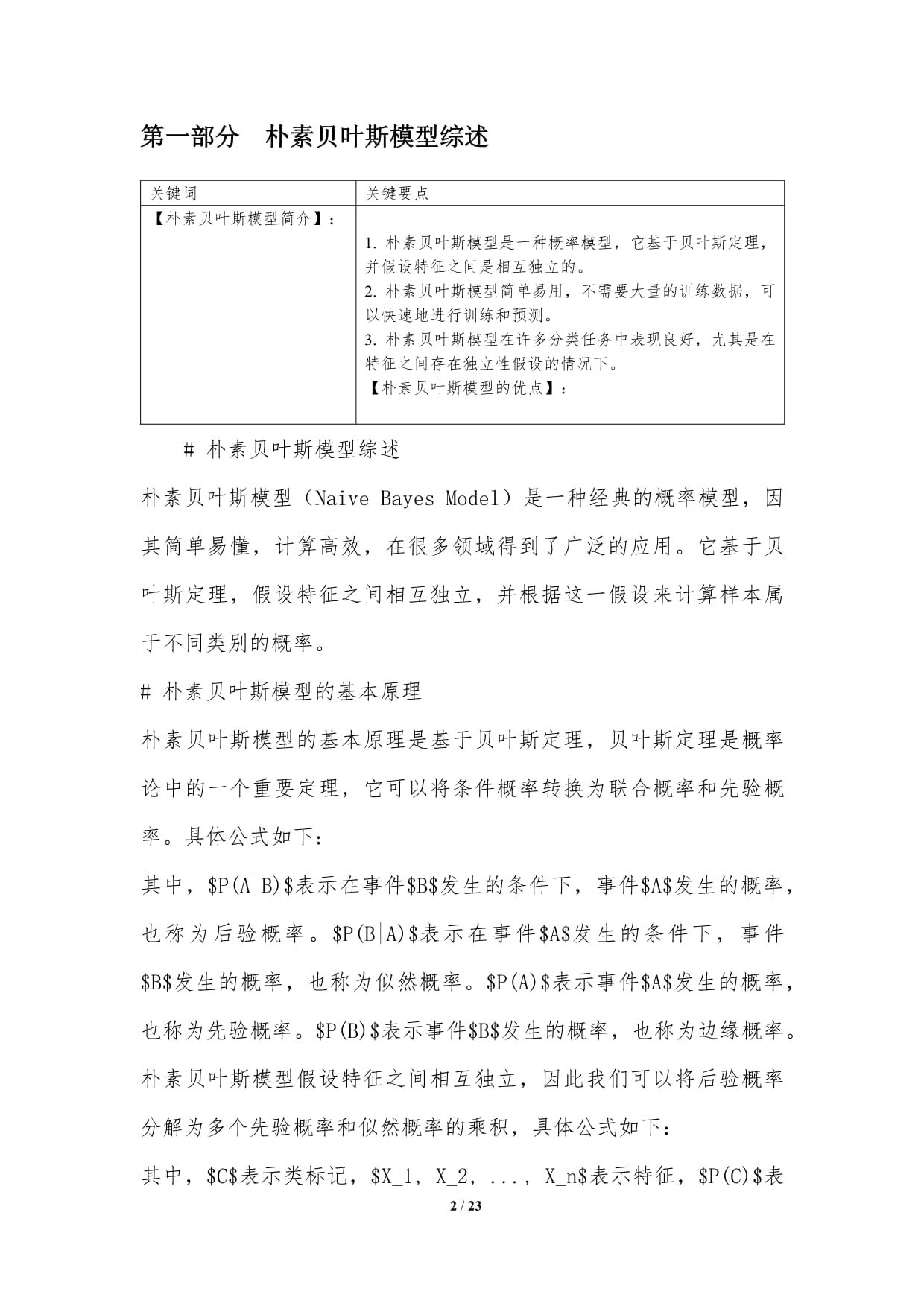

第一部分朴素贝叶斯模型综述关键词关键要点【朴素贝叶斯模型简介】:

1.朴素贝叶斯模型是一种概率模型,它基于贝叶斯定理,并假设特征之间是相互独立的。

2.朴素贝叶斯模型简单易用,不需要大量的训练数据,可以快速地进行训练和预测。

3.朴素贝叶斯模型在许多分类任务中表现良好,尤其是在特征之间存在独立性假设的情况下。

【朴素贝叶斯模型的优点】:

#朴素贝叶斯模型综述

朴素贝叶斯模型(NaiveBayesModel)是一种经典的概率模型,因其简单易懂,计算高效,在很多领域得到了广泛的应用。它基于贝叶斯定理,假设特征之间相互独立,并根据这一假设来计算样本属于不同类别的概率。

#朴素贝叶斯模型的基本原理

朴素贝叶斯模型的基本原理是基于贝叶斯定理,贝叶斯定理是概率论中的一个重要定理,它可以将条件概率转换为联合概率和先验概率。具体公式如下:

其中,$P(A|B)$表示在事件$B$发生的条件下,事件$A$发生的概率,也称为后验概率。$P(B|A)$表示在事件$A$发生的条件下,事件$B$发生的概率,也称为似然概率。$P(A)$表示事件$A$发生的概率,也称为先验概率。$P(B)$表示事件$B$发生的概率,也称为边缘概率。

朴素贝叶斯模型假设特征之间相互独立,因此我们可以将后验概率分解为多个先验概率和似然概率的乘积,具体公式如下:

其中,$C$表示类标记,$X_1,X_2,...,X_n$表示特征,$P(C)$表示类标记的先验概率,$P(X_i|C)$表示在类标记$C$的条件下,特征$X_i$的似然概率,$P(X_1,X_2,...,X_n)$表示特征的边缘概率。

朴素贝叶斯模型通过计算后验概率来对样本进行分类,后验概率最大的类标记即为样本的预测类别。

#朴素贝叶斯模型的优点和缺点

朴素贝叶斯模型的主要优点包括:

1.模型简单易懂,计算高效,适合处理大规模的数据集。

2.模型对缺失数据的鲁棒性较强,即使存在缺失数据,也能进行有效的预测。

3.模型对特征的分布不敏感,即使特征的分布不符合正态分布,也能进行有效的预测。

朴素贝叶斯模型的主要缺点包括:

1.模型假设特征之间相互独立,这在现实世界中往往不成立,因此模型的预测结果可能会受到影响。

2.模型对噪声数据的敏感性较强,如果训练数据中存在噪声数据,则模型的预测结果可能会受到影响。

3.模型对极端数据点的敏感性较强,如果训练数据中存在极端数据点,则模型的预测结果可能会受到影响。

#朴素贝叶斯模型的应用

朴素贝叶斯模型在很多领域得到了广泛的应用,包括:

1.文本分类:朴素贝叶斯模型可以用于对文本进行分类,例如新闻分类、垃圾邮件分类等。

2.图像分类:朴素贝叶斯模型可以用于对图像进行分类,例如人脸识别、物体识别等。

3.推荐系统:朴素贝叶斯模型可以用于构建推荐系统,例如电影推荐、音乐推荐等。

4.欺诈检测:朴素贝叶斯模型可以用于检测欺诈行为,例如信用卡欺诈、网络欺诈等。

5.医疗诊断:朴素贝叶斯模型可以用于对疾病进行诊断,例如癌症诊断、心脏病诊断等。

朴素贝叶斯模型是一种简单易懂,计算高效的概率模型,在很多领域得到了广泛的应用。然而,朴素贝叶斯模型也存在一些缺点,例如对特征独立性的假设、对噪声数据和极端数据点的敏感性等。为了克服这些缺点,我们可以对朴素贝叶斯模型进行改进,例如使用贝叶斯网络来代替朴素贝叶斯模型、使用集成学习来提高模型的鲁棒性等。第二部分集成学习概念与分类关键词关键要点集成学习

1.集成学习的概念:集成学习是一种通过将多个基学习器的预测结果进行组合,以提高预测准确性的机器学习方法。基学习器可以是任意类型的机器学习算法,如决策树、支持向量机或神经网络。

2.集成学习的优势:集成学习可以有效减少模型的过拟合问题,提高模型的泛化能力;集成学习可以提高模型的预测准确性,因为不同的基学习器可能对不同的数据样本具有不同的预测能力,组合后的结果可以取长补短,得到更准确的预测。

3.集成学习的类型:集成学习有多种类型,包括Bagging、Boosting、Stacking等;Bagging(BootstrapAggregating)是集成学习中最基本的一种方法,它通过对数据进行有放回的随机采样,构建多个基学习器,并将这些基学习器的预测结果进行简单的平均或投票得到最终预测;Boosting(AdaptiveBoosting)是一种迭代型的集成学习方法,它根据基学习器的预测结果对数据样本进行加权,并以此作为下一个基学习器的训练数据,如此反复,直到达到指定的迭代次数或满足一定的终止条件;Stacking是一种高级的集成学习方法,它将多个基学习器的预测结果作为输入,构建一个新的模型(通常是一个监督学习模型)来进行最终预测。

集成学习中的朴素贝叶斯分类器

1.朴素贝叶斯分类器简介:朴素贝叶斯分类器是一种基于贝叶斯定理的分类算法,它假设特征之间相互独立,并利用特征的概率分布来进行分类。朴素贝叶斯分类器简单易于实现,且在某些情况下可以达到很好的分类效果。

2.朴素贝叶斯分类器的优点:朴素贝叶斯分类器具有如下优点:

-计算简单,训练速度快;

-对缺失值不敏感;

-可以处理高维数据;

-不容易过拟合。

3.朴素贝叶斯分类器的缺点:朴素贝叶斯分类器也存在一些缺点,例如:

-对特征之间的相关性敏感,如果特征之间存在强相关性,则分类效果会下降;

-对噪声数据敏感,如果训练数据中存在大量噪声数据,则分类效果也会下降。集成学习概念与分类

集成学习(EnsembleLearning)是机器学习中一种有效的学习策略,它通过组合多个模型来提高整体的学习效果。集成学习的思想是通过构建多个独立的模型,然后将这些模型的预测结果进行某种形式的组合,以得到最终的预测结果。集成学习可以有效地降低模型的方差和偏差,从而提高模型的泛化能力。

集成学习的分类有多种,常见的有:

#1.Bagging(BootstrapAggregating)

Bagging是一种并行集成学习方法,它通过对训练集进行有放回的重复采样,生成多个子训练集,然后在每个子训练集上训练一个模型,最后将各个模型的预测结果进行平均或投票,得到最终的预测结果。Bagging可以有效地降低模型的方差,提高模型的鲁棒性。

#2.Boosting(BoostingbyAggregating)

Boosting是一种串行集成学习方法,它通过对训练集进行多轮迭代,在每轮迭代中,根据前一轮迭代的模型的预测结果,调整训练集的权重,然后在调整后的训练集上训练一个新的模型,最后将各个模型的预测结果进行加权平均,得到最终的预测结果。Boosting可以有效地降低模型的偏差,提高模型的准确性。

#3.Stacking(Stacking)

Stacking是一种串行集成学习方法,它通过将多个模型的预测结果作为输入,训练一个新的模型,然后将这个新的模型的预测结果作为最终的预测结果。Stacking可以有效地提高模型的准确性和泛化能力。

#4.MixtureofExperts(MixtureofExperts)

MixtureofExperts是一种集成学习方法,它通过将多个模型进行组合,形成一个专家委员会,然后将输入数据分配给不同的专家模型,由专家模型分别做出预测,最后将各个专家模型的预测结果进行加权平均,得到最终的预测结果。MixtureofExperts可以有效地提高模型的准确性和泛化能力。

集成学习是一种有效的学习策略,它可以有效地降低模型的方差和偏差,提高模型的泛化能力。集成学习在许多领域都有着广泛的应用,如图像识别、自然语言处理、信息检索等。第三部分朴素贝叶斯集成学习架构关键词关键要点朴素贝叶斯集成学习的优点

1.朴素贝叶斯集成学习能够有效地提高分类精度。通过将多个朴素贝叶斯模型集成在一起,可以综合每个模型的优点,从而提高分类的整体准确率。

2.朴素贝叶斯集成学习可以减少过拟合的风险。由于朴素贝叶斯模型是一个简单的分类器,容易出现过拟合的问题。通过集成多个朴素贝叶斯模型,可以降低过拟合的风险,提高模型的泛化能力。

3.朴素贝叶斯集成学习可以提高模型的鲁棒性。由于朴素贝叶斯模型对数据中的噪声和异常值比较敏感,容易受到影响。通过集成多个朴素贝叶斯模型,可以提高模型的鲁棒性,使其对噪声和异常值不那么敏感。

朴素贝叶斯集成学习的类型

1.串行集成:串行集成是一种简单的集成方法,它将多个朴素贝叶斯模型按顺序排列,并逐个对数据进行分类。每个模型的输出作为下一个模型的输入,以此类推。

2.并行集成:并行集成是一种更复杂的集成方法,它将多个朴素贝叶斯模型并行排列,并同时对数据进行分类。每个模型的输出独立地进行处理,然后将结果进行汇总,以获得最终的分类结果。

3.混合集成:混合集成是一种介于串行集成和并行集成之间的集成方法。它将串行集成和并行集成结合起来,以获得更好的性能。

朴素贝叶斯集成学习的应用

1.文本分类:朴素贝叶斯集成学习可以用于文本分类任务。通过将多个朴素贝叶斯模型集成在一起,可以提高文本分类的准确率,并减少过拟合的风险。

2.图像分类:朴素贝叶斯集成学习可以用于图像分类任务。通过将多个朴素贝叶斯模型集成在一起,可以提高图像分类的准确率,并降低噪声和异常值的影响。

3.医疗诊断:朴素贝叶斯集成学习可以用于医疗诊断任务。通过将多个朴素贝叶斯模型集成在一起,可以提高医疗诊断的准确率,并减少误诊的风险。1.朴素贝叶斯集成学习架构概述

朴素贝叶斯集成学习架构是一种将多个朴素贝叶斯分类器组合起来,以提高分类性能的集成学习方法。该架构通常包括以下几个步骤:

1.1训练多个朴素贝叶斯分类器

首先,需要训练多个朴素贝叶斯分类器。这些分类器可以是相同类型的,也可以是不同类型的。例如,可以训练多个高斯朴素贝叶斯分类器,也可以训练多个多项式朴素贝叶斯分类器,或者混合训练高斯朴素贝叶斯分类器和多项式朴素贝叶斯分类器。

1.2组合分类器结果

训练好多个朴素贝叶斯分类器后,就可以将它们的结果组合起来。组合方法有多种,常用的方法包括:

(1)平均法:将多个分类器的预测结果取平均值作为最终的预测结果。

(2)加权平均法:将多个分类器的预测结果按照一定的权重进行加权平均,作为最终的预测结果。

(3)投票法:将多个分类器的预测结果进行投票,票数最多的类别作为最终的预测结果。

1.3提高分类性能

通过将多个朴素贝叶斯分类器集成起来,可以提高分类性能。这是因为集成学习可以减少每个分类器的错误率,并提高分类的准确性。

2.朴素贝叶斯集成学习架构的具体实现

朴素贝叶斯集成学习架构的具体实现有多种,常用的方法包括:

2.1Bagging

Bagging(BootstrapAggregating)是一种常见的集成学习方法。该方法通过对训练数据进行有放回的采样,生成多个训练集。然后,在每个训练集上训练一个朴素贝叶斯分类器。最后,将这些分类器的结果组合起来,作为最终的预测结果。

2.2Boosting

Boosting是一种另一种常见的集成学习方法。该方法通过对训练数据进行加权,使得分类器对错误分类的数据点赋予更高的权重。然后,在每次迭代中,训练一个新的朴素贝叶斯分类器,并更新数据点的权重。最后,将这些分类器的结果组合起来,作为最终的预测结果。

2.3Stacking

Stacking是一种比较复杂的集成学习方法。该方法通过将多个朴素贝叶斯分类器的预测结果作为输入,训练一个新的分类器。这个新的分类器称为元分类器。元分类器的输出作为最终的预测结果。

3.朴素贝叶斯集成学习架构的应用

朴素贝叶斯集成学习架构已被广泛应用于各种分类任务中,包括文本分类、图像分类、语音识别等。该架构在许多任务中都取得了很好的分类性能。

4.朴素贝叶斯集成学习架构的优缺点

朴素贝叶斯集成学习架构具有以下优点:

-简单易用:朴素贝叶斯集成学习架构简单易用,易于实现。

-分类性能好:朴素贝叶斯集成学习架构可以显著提高分类性能。

-鲁棒性强:朴素贝叶斯集成学习架构对噪声和异常值具有较强的鲁棒性。

朴素贝叶斯集成学习架构也存在一些缺点:

-训练时间长:朴素贝叶斯集成学习架构需要训练多个朴素贝叶斯分类器,因此训练时间较长。

-内存消耗大:朴素贝叶斯集成学习架构需要存储多个朴素贝叶斯分类器的模型,因此内存消耗较大。

-容易过拟合:朴素贝叶斯集成学习架构容易过拟合,因此需要使用正则化技术来防止过拟合。第四部分朴素贝叶斯集成学习方法关键词关键要点【朴素贝叶斯集成学习方法】:

1.朴素贝叶斯集成学习的基本思想是将多个朴素贝叶斯分类器结合起来,形成一个新的更强大的分类器。

2.朴素贝叶斯集成学习方法主要有两种:并行集成和串行集成。

3.并行集成方法是指将多个朴素贝叶斯分类器并行地应用于同一数据集,然后将分类结果进行投票或加权平均,得到最终的分类结果。

4.串行集成方法是指将多个朴素贝叶斯分类器串行地应用于同一数据集,前一个分类器的输出作为下一个分类器的输入,最终得到分类结果。

【朴素贝叶斯集成学习的优点】:

朴素贝叶斯集成学习方法

朴素贝叶斯集成学习方法是指将多个朴素贝叶斯模型结合起来,形成一个更强大的集成模型。集成学习方法可以有效地提高朴素贝叶斯模型的准确性和鲁棒性。

朴素贝叶斯集成学习方法主要包括以下几种:

*Bagging(BootstrapAggregating):Bagging是一种并行集成学习方法,通过对原始数据集进行多次有放回的抽样,生成多个子数据集,然后分别在每个子数据集上训练一个朴素贝叶斯模型。最后将这些朴素贝叶斯模型的预测结果进行平均或投票,得到最终的集成模型的预测结果。

*Boosting(AdaBoost):Boosting是一种串行集成学习方法,通过对原始数据集进行多次迭代训练,生成多个朴素贝叶斯模型。在每次迭代中,Boosting会根据前一次迭代中朴素贝叶斯模型的预测结果,对原始数据集中的样本重新赋予权重。然后,在新的权重下重新训练朴素贝叶斯模型。最后,将这些朴素贝叶斯模型的预测结果进行加权平均,得到最终的集成模型的预测结果。

*Stacking(StackedGeneralization):Stacking是一种混合集成学习方法,通过将多个朴素贝叶斯模型的预测结果作为输入,训练一个新的模型。这个新的模型称为元模型(meta-model)。元模型的预测结果就是最终的集成模型的预测结果。

朴素贝叶斯集成学习方法的优点包括:

*提高准确性:朴素贝叶斯集成学习方法可以有效地提高朴素贝叶斯模型的准确性。这是因为集成学习方法可以减少朴素贝叶斯模型的方差,从而提高模型的泛化能力。

*提高鲁棒性:朴素贝叶斯集成学习方法可以提高朴素贝叶斯模型的鲁棒性。这是因为集成学习方法可以减少朴素贝叶斯模型对噪声和异常值的敏感性。

*并行训练:朴素贝叶斯集成学习方法中的Bagging和Boosting方法可以并行训练,从而提高训练速度。

朴素贝叶斯集成学习方法的缺点包括:

*计算量大:朴素贝叶斯集成学习方法需要训练多个朴素贝叶斯模型,因此计算量较大。

*存储空间大:朴素贝叶斯集成学习方法需要存储多个朴素贝叶斯模型的模型参数,因此存储空间较大。

*模型解释性差:朴素贝叶斯集成学习方法的模型解释性较差,因为集成学习方法将多个朴素贝叶斯模型组合在一起,因此难以解释最终的集成模型的预测结果。第五部分朴素贝叶斯融合算法综述关键词关键要点【朴素贝叶斯融合算法综述】:

1.朴素贝叶斯融合算法是一种将多个朴素贝叶斯模型的预测结果进行融合,以提高模型的整体性能的算法。

2.朴素贝叶斯融合算法可以分为两类:硬性融合算法和软性融合算法。硬性融合算法直接将多个朴素贝叶斯模型的预测结果进行组合,而软性融合算法则对多个朴素贝叶斯模型的预测结果进行加权平均。

3.朴素贝叶斯融合算法可以提高模型的整体性能,并且对数据的分布不敏感。

【朴素贝叶斯模型的集成学习】:

朴素贝叶斯融合综述

朴素贝叶斯融合是将朴素贝叶斯分类器集成到一个更强大的分类器中的过程。朴素贝叶斯分类器是简单但有效的机器学习方法,它根据训练数据中各个特徵與類別的相关性,为新数据点做出分类预测。融合是将來自多個来源或子分类器的分类结果进行組合,以做出更准确的预测。

朴素贝叶斯融合的方法有很多種。最常見的方法有:

*加权平均:这种方法将每個朴素贝叶斯分类器的结果根据权重进行加权平均。权重可以根据各个分類器的准确性或其他指标来调整。

*投票:这种方法根据各个朴素贝叶斯分类器给出的一致票数来做出预测。如果大多数分类器都预测一个类,那么该类就是预测结果。

*堆叠:这种方法将各个朴素贝叶斯分类器的结果作为输入,并使用另一个分类器来做出预测。堆叠分类器可以是朴素贝叶斯分类器,也可是其他类型的分类器。

朴素贝叶斯融合可以显著地改進分类器的准确性。在許多應用中,基於朴素贝叶斯融合的分类器都优于單個朴素贝叶斯分类器。

朴素贝叶斯融合也有一些缺点。主要缺点是它可能会增加分类器的复杂性和训练时间。融合可能还会導致分类器过度拟合训练数据,或对训练数据中的噪声和异常值很敏感。

總體來說,朴素贝叶斯融合是一種強大的方法,可以顯著改進分類器的準確率。但是,需要謹慎使用融合,以避免过度拟合和复杂性增加。

#朴素贝叶斯融合的應用

朴素贝叶斯融合已被用於多種應用中,包括:

-入侵检测、欺诈检测和信用评分。

-医学診症,如癌症檢測和心臟病診斷。

-自然语言处理,如情感分析和机器翻譯。

-图像识别,如面部识别和物体检测。

-语音识别,如語音控制和語音轉換文字。

朴素贝叶斯融合在解决这些问题方面的记录是有目共睹的。

#朴素贝叶斯融合的未來研究方向

朴素贝叶斯融合是一個很有前途的領域,仍有很多问题有待解決。一些未來研究方向包括:

-研究更先進的融合方法,可以更好地利用多個朴素贝叶斯分类器的优点。

-考慮朴素贝叶斯融合的並行和分佈式实现。

-融合的元学习,以使分类器能夠了解或适应不同融合技术的优点和缺点。

-朴素贝叶斯融合在新的應用中的研究,如強化學習和推荐系统。

朴素贝叶斯融合仍处于早期发展阶段,但它已经显示出解决复杂问题的强大潜力。隨著對融合方法的深入研究,可以預期朴素贝叶斯融合在未來几年中將變得越來越重要。第六部分朴素贝叶斯融合算法类型关键词关键要点【朴素贝叶斯模型融合算法】:

1.确定贝叶斯模型的集合:该集合可以由不同的朴素贝叶斯模型组成,这些模型可以具有不同的特征集、不同的先验分布或不同的学习算法。

2.定义融合规则:融合规则指定了如何将各个贝叶斯模型的输出组合起来,以得到最终的分类结果。常见的融合规则包括加权平均、最大值规则、最小值规则、中位数规则和乘积规则等。

3.评估融合模型:融合模型的评估与标准的分类模型类似,可以使用准确率、召回率、F1值等指标来衡量其性能。

【朴素贝叶斯贝叶斯模型的集成】:

朴素贝叶斯融合算法类型

朴素贝叶斯融合算法主要分为以下几类:

#1.简单贝叶斯融合

简单贝叶斯融合(SimpleBayesianFusion)是一种最简单的朴素贝叶斯融合算法,它将多个朴素贝叶斯分类器的输出概率进行加权平均,得到最终的融合结果。其中,每个朴素贝叶斯分类器的权重由其分类精度决定。简单贝叶斯融合算法的具体步骤如下:

-训练多个朴素贝叶斯分类器,每个分类器使用不同的训练数据集。

-计算每个朴素贝叶斯分类器的分类精度。

-将每个朴素贝叶斯分类器的权重设置为其分类精度。

-对于每个测试样本,使用每个朴素贝叶斯分类器进行分类,并将分类结果按照权重进行加权平均,得到最终的融合结果。

#2.贝叶斯模型平均(BMA)

贝叶斯模型平均(BayesianModelAveraging,BMA)是一种基于贝叶斯推理的朴素贝叶斯融合算法。BMA算法通过计算每个朴素贝叶斯分类器的后验概率,然后将这些后验概率作为权重,对朴素贝叶斯分类器的输出结果进行加权平均,得到最终的融合结果。

BMA算法的具体步骤如下:

-训练多个朴素贝叶斯分类器,每个分类器使用不同的训练数据集。

-计算每个朴素贝叶斯分类器的后验概率。

-将每个朴素贝叶斯分类器的权重设置为其后验概率。

-对于每个测试样本,使用每个朴素贝叶斯分类器进行分类,并将分类结果按照权重进行加权平均,得到最终的融合结果。

#3.堆叠泛化(StackingGeneralization)

堆叠泛化(StackingGeneralization)是一种常见的元学习算法,它可以将多个朴素贝叶斯分类器的预测结果进行融合,得到最终的融合结果。堆叠泛化算法的具体步骤如下:

-训练多个朴素贝叶斯分类器,每个分类器使用不同的训练数据集。

-将朴素贝叶斯分类器的预测结果作为输入,训练一个新的分类器(称为元分类器)。

-对于每个测试样本,使用朴素贝叶斯分类器进行预测,并将预测结果作为输入,通过元分类器得到最终的融合结果。

#4.混合朴素贝叶斯(HybridNaiveBayes)

混合朴素贝叶斯(HybridNaiveBayes,HNB)是一种将朴素贝叶斯分类器与其他分类器融合的算法。HNB算法通过将朴素贝叶斯分类器的输出结果与其他分类器的输出结果进行融合,得到最终的融合结果。

HNB算法的具体步骤如下:

-训练多个朴素贝叶斯分类器,每个分类器使用不同的训练数据集。

-训练其他分类器,使用相同的训练数据集。

-将朴素贝叶斯分类器的输出结果与其他分类器的输出结果进行融合,得到最终的融合结果。

#5.多任务学习(Multi-TaskLearning)

多任务学习(Multi-TaskLearning,MTL)是一种同时学习多个相关任务的机器学习方法。MTL算法可以将多个朴素贝叶斯分类器同时训练,并通过共享参数和知识,提高朴素贝叶斯分类器的性能。

MTL算法的具体步骤如下:

-定义多个相关任务。

-训练多个朴素贝叶斯分类器,每个分类器对应一个任务。

-将朴素贝叶斯分类器的参数和知识进行共享,以提高朴素贝叶斯分类器的性能。

-对于每个测试样本,使用朴素贝叶斯分类器进行预测,得到最终的融合结果。第七部分朴素贝叶斯融合算法比较关键词关键要点【贝叶斯证据论】:

1.贝叶斯证据论是贝叶斯推理的重要组成部分,它涉及证据的更新和融合。

2.贝叶斯证据论提供了证据更新和融合的理论基础,为朴素贝叶斯融合算法的开发提供了理论支持。

3.贝叶斯证据论可以有效地处理证据的的不确定性,并在证据融合过程中对证据的可靠性和相关性进行评估,从而提高融合算法的准确性和鲁棒性。

【证据更新】:

朴素贝叶斯融合算法比较

朴素贝叶斯融合算法是将多个朴素贝叶斯分类器结合起来,以提高分类精度。朴素贝叶斯融合算法包括串行融合算法、并行融合算法和混合融合算法。

#串行融合算法

串行融合算法是一种简单的朴素贝叶斯融合算法,它将多个朴素贝叶斯分类器的输出作为输入,并使用一个简单的规则来组合这些输出以得出最终的分类结果。串行融合算法的优点是简单易实现,但缺点是分类精度不高。

#并行融合算法

并行融合算法是一种复杂但有效的朴素贝叶斯融合算法,它将多个朴素贝叶斯分类器的输出作为输入,并使用一个复杂的模型来组合这些输出以得出最终的分类结果。并行融合算法的优点是分类精度高,但缺点是复杂难实现。

#混合融合算法

混合融合算法是串行融合算法和并行融合算法的结合,它将多个朴素贝叶斯分类器的输出作为输入,并使用一个简单的规则来组合这些输出以得出最终的分类结果。混合融合算法的优点是简单易实现,同时分类精度也较高。

#朴素贝叶斯融合算法比较

以下是朴素贝叶斯融合算法的比较表:

|算法|优点|缺点|

||||

|串行融合算法|简单易实现|分类精度不高|

|并行融合算法|分类精度高|复杂难实现|

|混合融合算法|简单易实现|分类精度较高|

#结论

朴素贝叶斯融合算法是一种有效提高朴素贝叶斯分类器分类精度的算法。朴素贝叶斯融合算法包括串行融合算法、并行融合算法和混合融合算法。串行融合算法简单易实现,但分类精度不高。并行融合算法分类精度高,但复杂难实现。混合融合算法简单易实现,同时分类精度也较高。第八部分朴素贝叶斯集成与融合应用关键词关键要点朴素贝叶斯集成与融合应用于文本分类

1.将朴素贝叶斯模型与其他分类器集成,可以提高文本分类的准确率和鲁棒性。

2.可以使用不同的集成方法,如投票法、贝叶斯组合、堆叠集成等,将多个朴素贝叶斯模型集成在一起。

3.也可以使用朴素贝叶斯模型来融合不同信息源的信息,从而提高文本分类的准确率。

朴素贝叶斯集成与融合应用于图像分类

1.将朴素贝叶斯模型与其他分类器集成,可以提高图像分类的准确率和鲁棒性。

2.可以使用不同的集成方法,如投票法、贝叶斯组合、堆叠集成等,将多个朴素贝叶斯模型集成在一起。

3.也可以使用朴素贝叶斯模型来融合不同光谱段或不同视角的图像信息,从而提高图像分类的准确率。

朴素贝叶斯集成与融合应用于语音识别

1.将朴素贝叶斯模型与其他语音识别算法集成,可以提高语音识别的准确率和鲁棒性。

2.可以使用不同的集成方法,如投票法、贝叶斯组合、堆叠集成等,将多个朴素贝叶斯模型集成在一起。

3.也可以使用朴素贝叶斯模型来融合不同麦克风或不同语音通道的信息,从而提高语音识别的准确率。

朴素贝叶斯集成与融合应用于信息检索

1.将朴素贝叶斯模型与其他信息检索算法集成,可以提高信息检索的准确率和召回率。

2.可以使用不同的集成方法,如投票法、贝叶斯组合、堆叠集成等,将多个朴素贝叶斯模型集成在一起。

3.也可以使用朴素贝叶斯模型来融合不同查询词语或不同查询条件的信息,从而提高信息检索的准确率和召回率。

朴素贝叶斯集成与融合应用于医学诊断

1.将朴素贝叶斯模型与其他医学诊断算法集成,可以提高医学诊断的准确率和鲁棒性。

2.可以使用不同的集成方法,如投票法、贝叶斯组合、堆叠集成等,将多个朴素贝叶斯模型集成在一起。

3.也可以使用朴素贝叶斯模型来融合不同症状或不同检查结果的信息,从而提高医学诊断的准确率和鲁棒性。

朴素贝叶斯集成与融合应用于金融欺诈检测

1.将朴素贝叶斯模型与其他金融欺诈检测算法集成,可以提高金融欺诈检测的准确率和鲁棒性。

2.可以使用不同的集成方法,如投票法、贝叶斯组合、堆叠集成等,将多个朴素贝叶斯模型集成在一起。

3.也可以使用朴素贝叶斯模型来融合不同交易记录或不同用户行为信息,从而提高金融欺诈检测的准确率和鲁棒性。朴素贝叶斯集成与融合应用

朴素贝叶斯(NB)模型是一种简单且有效的分类算法,

温馨提示

- 1. 本站所有资源如无特殊说明,都需要本地电脑安装OFFICE2007和PDF阅读器。图纸软件为CAD,CAXA,PROE,UG,SolidWorks等.压缩文件请下载最新的WinRAR软件解压。

- 2. 本站的文档不包含任何第三方提供的附件图纸等,如果需要附件,请联系上传者。文件的所有权益归上传用户所有。

- 3. 本站RAR压缩包中若带图纸,网页内容里面会有图纸预览,若没有图纸预览就没有图纸。

- 4. 未经权益所有人同意不得将文件中的内容挪作商业或盈利用途。

- 5. 人人文库网仅提供信息存储空间,仅对用户上传内容的表现方式做保护处理,对用户上传分享的文档内容本身不做任何修改或编辑,并不能对任何下载内容负责。

- 6. 下载文件中如有侵权或不适当内容,请与我们联系,我们立即纠正。

- 7. 本站不保证下载资源的准确性、安全性和完整性, 同时也不承担用户因使用这些下载资源对自己和他人造成任何形式的伤害或损失。

最新文档

- 二零二五年度工业设备安装与调试服务合同3篇

- 二零二五版快递企业快递物品安全防护合同大全3篇

- 2025年度城市综合体门头广告品牌形象改造合同3篇

- 2025年度拆迁安置房交易全程跟踪服务合同协议3篇

- 个人消费性借款合同(2024版)9篇

- 二零二五年度可再生能源发电特许经营合作协议合同范本

- 二零二五年度医疗健康信息化运维保障合同2篇

- 2025版商业物业安全责任书(含应急预案)3篇

- 2025年度个性化产后恢复与新生儿护理个人月嫂服务协议4篇

- 2025年度个人退伙经营协议书(房地产租赁合作版)4篇

- 《装配式蒸压加气混凝土外墙板保温系统构造》中

- T-CSTM 01124-2024 油气管道工程用工厂预制袖管三通

- 2019版新人教版高中英语必修+选择性必修共7册词汇表汇总(带音标)

- 新译林版高中英语必修二全册短语汇总

- 基于自适应神经网络模糊推理系统的游客规模预测研究

- 河道保洁服务投标方案(完整技术标)

- 品管圈(QCC)案例-缩短接台手术送手术时间

- 精神科病程记录

- 阅读理解特训卷-英语四年级上册译林版三起含答案

- 清华大学考博英语历年真题详解

- 人教版三年级上册口算题(全册完整20份 )

评论

0/150

提交评论